2024 年我们在 LLM 方面学到的东西

在 2024 年,大型语言模型(Large Language Models, LLM)领域发生了 很多 事情。这是一篇回顾过去十二个月里我们在这个领域弄清楚的事情的文章,加上我尝试识别的关键主题和关键时刻。

GPT-4 壁垒被全面打破

在我 2023 年 12 月——OpenAI 最好的模型在那时已经快一年了,但没有其他 AI 实验室能生产出更好的模型。OpenAI 知道什么而我们其他人不知道?

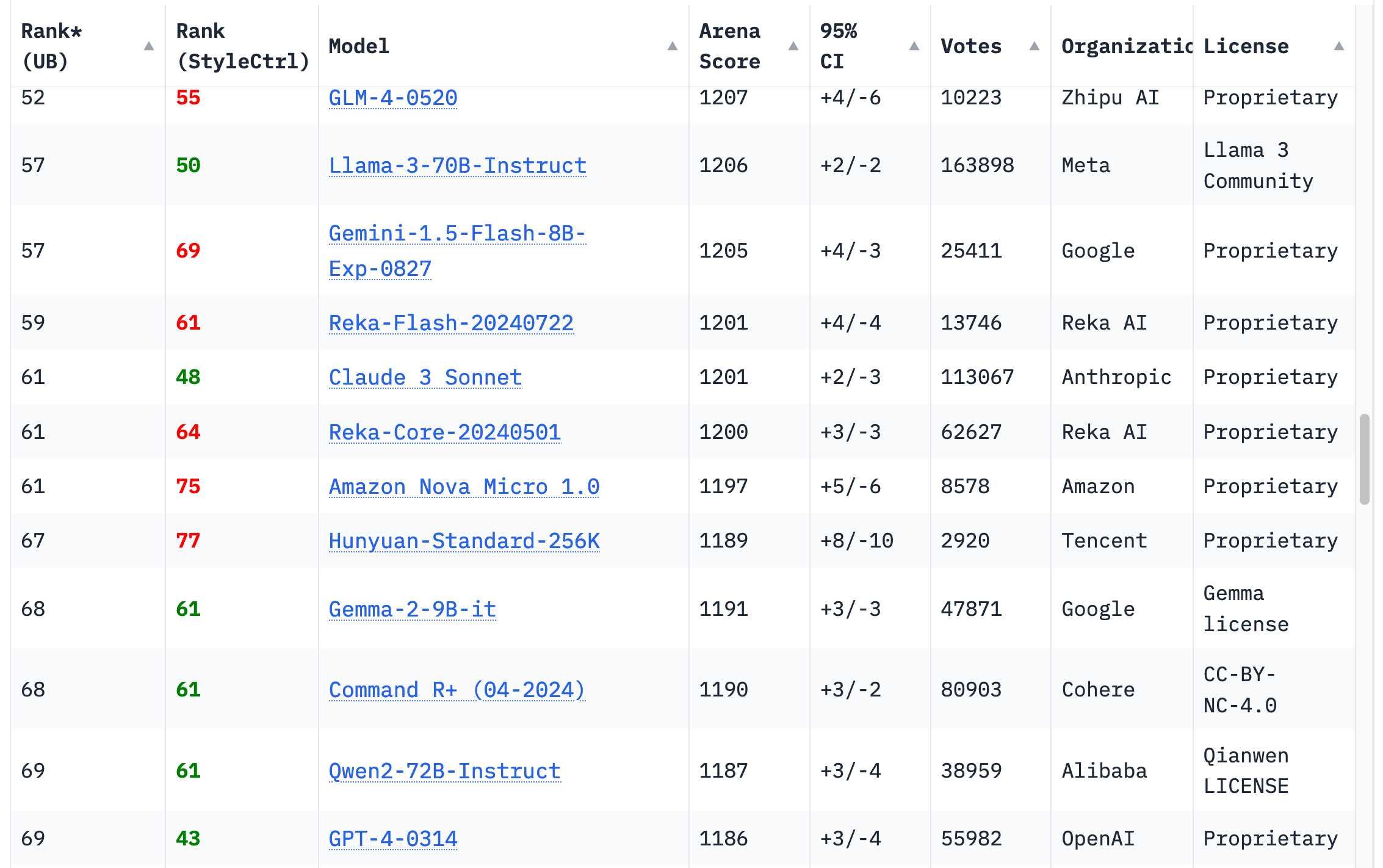

我感到欣慰的是,这种情况在过去的十二个月里已经彻底改变了。现在有 18 个组织在 Chatbot Arena Leaderboard 上拥有模型,排名高于 2023 年 3 月的原始 GPT-4(排行榜上的 GPT-4-0314)——总共有 70 个模型。

其中最早的是 Google 的 Gemini 1.5 Pro,于 2 月发布。除了产生 GPT-4 级别的输出外,它还为该领域引入了几项全新的功能——最值得注意的是其 100 万(后来增加到 200 万)token 的输入上下文长度,以及输入视频的能力。

Gemini 1.5 Pro 也说明了 2024 年的一个关键主题:上下文长度的增加。去年(2023年),大多数模型接受 4,096 或 8,192 个 token,但 Claude 2.1 是一个值得注意的例外,它 接受 200,000 个 token。如今,每个重要的提供商都拥有 100,000+ token 的模型,而 Google 的 Gemini 系列最多可接受 200 万个 token。

更长的输入大大增加了可以使用 LLM 解决的问题的范围:你现在可以输入整本书并询问有关其内容的问题,但更重要的是,你可以输入 大量 示例代码,以帮助模型正确解决编码问题。与仅依赖于模型权重中已有的信息的短提示相比,涉及长输入的 LLM 用例对我来说更有趣。

回到击败 GPT-4 的模型:Anthropic 的 Claude 3 系列于 3 月推出,Claude 3 Opus 迅速成为我最喜欢的新日常模型。他们在 6 月通过推出 Claude 3.5 Sonnet 进一步提高了标准——这个模型仍然是我六个月后最喜欢的模型(尽管它在 10 月 22 日 进行了重大升级,令人困惑的是保留了相同的 3.5 版本号。Anthropic 的粉丝们从此开始称其为 Claude 3.6)。

还有其他的模型。如果你今天浏览 Chatbot Arena 排行榜——它仍然是基于氛围评估模型的最有用的单一场所——你会看到 GPT-4-0314 已经跌至大约第 70 位。拥有更高评分模型的 18 个组织是 Google、OpenAI、阿里巴巴、Anthropic、Meta、Reka AI、01 AI、亚马逊、Cohere、DeepSeek、Nvidia、Mistral、NexusFlow、智谱 AI、xAI、AI21 Labs、普林斯顿和腾讯。

在 2023 年,训练一个击败 GPT-4 的模型是一件大事。在 2024 年,这甚至不是一个特别值得注意的成就,尽管我个人仍然为任何新组织加入该名单而庆祝。

其中一些 GPT-4 模型可以在我的笔记本电脑上运行

我的个人笔记本电脑是一台 2023 年的 64GB M2 MacBook Pro。它是一台强大的机器,但现在也快两年了——而且至关重要的是,自从我 2023 年 3 月首次在我的电脑上运行 LLM 以来,我一直都在使用这台笔记本电脑。

去年 3 月只能勉强运行 GPT-3 级别模型的同一台笔记本电脑,现在已经可以运行多个 GPT-4 级别的模型了!

这仍然让我感到惊讶。我以为具有 GPT-4 的能力和输出质量的模型需要一个数据中心级别的服务器,配备一个或多个 40,000 美元以上的 GPU。

这些模型占用了我 64GB 内存中的大部分,以至于我不经常运行它们——它们没有留下太多空间给其他东西。

它们能够运行本身就证明了我们在过去一年中弄清楚的令人难以置信的训练和推理性能提升。事实证明,在模型效率方面,还有 很多 唾手可得的成果可以收获。我预计还会有更多。

Meta 的 Llama 3.2 模型值得特别提及。它们可能不是 GPT-4 级别的,但 1B 和 3B 的尺寸却 大大 超出了它们的水平。我在我的 iPhone 上使用免费的 MLC Chat iOS 应用程序 运行 Llama 3.2 3B,对于它微小的(<2GB)尺寸来说,它是一个令人震惊的强大模型。尝试启动它并要求它提供“一部 Netflix 圣诞电影的情节大纲,其中一位数据记者爱上了一位当地的陶瓷艺术家”。这是我得到的,速度达到了令人尊敬的每秒 20 个 token:

![Image 10: MLC Chat: Llama - [System] Ready to chat. a plot outline of a Netflix Christmas movie where a data journalist falls in love with a local ceramacist. Show as Markdown is turned on. Here's a plot outline for a Netflix Christmas movie: Title: "Love in the Clay" Plot Outline: We meet our protagonist, JESSICA, a data journalist who has just returned to her hometown of Willow Creek, a small, charming town nestled in the snow-covered mountains. She's back to work on a story about the town's history and the effects of gentrification on the local community.](https://static.simonwillison.net/static/2024/mlc-chat-christmas.jpg)

LLM 价格暴跌,这要归功于竞争和效率的提高

过去的十二个月见证了通过顶级托管 LLM 运行 prompt 的成本大幅下降。

在 2023 年 12 月(这是 OpenAI 定价页面的 互联网档案馆链接),OpenAI 对 GPT-4 收取每百万输入 token 30 美元,对当时新的 GPT-4 Turbo 收取 10 美元/百万 token,对 GPT-3.5 Turbo 收取 1 美元/百万 token。

今天,30 美元/百万 token 可以让你获得 OpenAI 最昂贵的模型 o1。GPT-4o 的价格为 2.50 美元(比 GPT-4 便宜 12 倍),GPT-4o mini 的价格为 0.15 美元/百万 token——比去年的 GPT-3.5 便宜近 7 倍,而且功能 强大得多 。

其他模型提供商的收费甚至更低。Anthropic 的 Claude 3 Haiku(3 月份发布,但仍然是他们最便宜的模型)的价格为 0.25 美元/百万 token。Google 的 Gemini 1.5 Flash 的价格为 0.075 美元/百万 token,他们的 Gemini 1.5 Flash 8B 的价格为 0.0375 美元/百万 token——这比去年 GPT-3.5 Turbo 便宜 27 倍。

这些价格下降是由两个因素驱动的:竞争加剧和效率提高。对于每个关心 LLM 环境影响的人来说,效率的提高 非常 重要。这些价格下降直接关系到运行 prompt 所使用的能源量。

对于大型 AI 数据中心建设对环境的影响,仍然有很多值得担心的地方,但是关于单个 prompt 的能源成本的许多担忧不再可信。

这是一个有趣的粗略计算:使用 Google 的 Gemini 1.5 Flash 8B(10 月发布),他们最便宜的模型,生成我的个人照片库中 68,000 张照片中每张照片的简短描述需要多少钱?

每张照片需要 260 个输入 token 和大约 100 个输出 token。

260 * 68,000 = 17,680,000 个输入 token

17,680,000 * 0.0375 美元/百万 = 0.66 美元

100 * 68,000 = 6,800,000 个输出 token

6,800,000 * 0.15 美元/百万 = 1.02 美元

处理 68,000 张图像的总成本为 1.68 美元。这太荒谬的便宜了,我不得不运行三次数字以确认我算对了。

这些描述有多好?这是我从这个命令中得到的:

llm -m gemini-1.5-flash-8b-latest describe -a IMG_1825.jpeg

针对这张加州科学院蝴蝶照片:

一个浅盘,很可能是蜂鸟或蝴蝶喂食器,是红色的。在盘子里可以看到橙子片的碎片。

两只蝴蝶位于喂食器中,一只蝴蝶是深棕色/黑色的,带有白色/奶油色的斑纹。另一只是一只大型棕色蝴蝶,带有浅棕色、米色和黑色斑纹的图案,包括明显的眼点。较大的棕色蝴蝶似乎正在吃水果。

260 个输入 token,92 个输出 token。成本约为 0.0024 美分(不到 1 美分的 400 分之一)。

效率的提高和价格的降低是我在 2024 年最喜欢的趋势。我希望以一小部分能源成本获得 LLM 的效用,看起来这就是我们正在得到的。

多模态视觉很常见,音频和视频开始出现

我上面的蝴蝶例子说明了 2024 年的另一个关键趋势:多模态 LLM 的兴起。

一年前,这些模型最引人注目的例子是 GPT-4 Vision,它在 OpenAI 2023 年 11 月的 DevDay 上发布。Google 的多模态 Gemini 1.0 于 2023 年 12 月 7 日宣布,因此它也(刚好)进入了 2023 年的窗口期。

在 2024 年,几乎每个重要的模型供应商都发布了多模态模型。我们看到了 Anthropic 的 Claude 3 系列 在 3 月份发布,Gemini 1.5 Pro 在 4 月份发布(图像、音频和视频),然后在 9 月份推出了 Qwen2-VL 和 Mistral 的 Pixtral 12B 以及 Meta 的 Llama 3.2 11B 和 90B 视觉模型。我们从 OpenAI 在 10 月份获得了音频输入和输出,然后在 11 月份看到了 Hugging Face 的 SmolVLM,12 月份看到了 亚马逊 Nova 的图像和视频模型。

我认为那些抱怨 LLM 改进速度放缓的人经常忽略了这些多模态模型方面的巨大进步。能够针对图像(以及音频和视频)运行 prompt 是一种应用这些模型的新颖而有趣的方式。

语音和实时摄像头模式是科幻小说变为现实

已经开始出现的音频和实时视频模式值得特别提及。

与 ChatGPT 对话的能力首次出现在 2023 年 9 月,但这在很大程度上是一种幻觉:OpenAI 使用了他们出色的 Whisper 语音转文本模型和一个新的文本转语音模型(创造性地命名为 tts-1)来支持与 ChatGPT 移动应用程序的对话,但实际模型只看到了文本。

5 月 13 日 发布的 GPT-4o 包含了一个全新的语音模式演示,真正的多模态 GPT-4o(o 代表“omni”)模型可以接受音频输入并输出令人难以置信的逼真语音,而无需单独的 TTS 或 STT 模型。

演示听起来也 与 Scarlett Johansson 非常相似... 在她抱怨后,演示中的声音 Skye 从未成为量产产品。

在最初的演示之后,新的语音模式的发布延迟引起了很多混乱。

当 ChatGPT 高级语音模式最终 确实 推出时(从 8 月到 9 月的缓慢推出),它非常壮观。我一直在遛狗时广泛使用它,令人惊叹的是,语调的改进在多大程度上提升了材料的质量。

OpenAI 并不是唯一拥有多模态音频模型的团队。Google 的 Gemini 也接受音频输入,Google Gemini 应用程序现在可以像 ChatGPT 一样说话。亚马逊也预先宣布了 Amazon Nova 的语音模式,但这预计在 2025 年第一季度推出。

Google 的 NotebookLM 于 9 月发布,通过生成关于你输入到他们工具中的任何内容的两个“播客主持人”之间令人毛骨悚然的逼真对话,将音频输出提升到了一个新的水平。他们后来添加了自定义指令。

最近的转变,再次来自 12 月(12 月 发生了很多事情)是实时视频。ChatGPT 语音模式现在提供了与模型共享摄像头 feed 并在实时模式下谈论你所看到内容的选项。Google Gemini 有相同功能的预览,他们设法在 ChatGPT 前一天发布了该功能。

这些功能在这一点上只有几周的历史,而且我认为它们的影响尚未完全显现。如果你还没有尝试过它们,你真的应该尝试一下。

Gemini 和 OpenAI 都提供对这些功能的 API 访问。OpenAI 从 WebSocket API开始,该 API 非常难以使用,但在 12 月,他们宣布了一个新的 WebRTC API,该 API 更容易上手。现在构建一个用户可以通过语音与之交谈的 Web 应用程序 很容易 !

Prompt 驱动的应用程序生成已经成为一种商品

这在 2023 年使用 GPT-4 是可能的,但它提供的价值在 2024 年变得显而易见。

我们已经知道 LLM 在编写代码方面出奇地出色。如果你正确地 prompt 它们,事实证明它们可以使用 HTML、CSS 和 JavaScript(以及 React 等工具,如果你连接一些额外的支持构建机制)为你构建 一个完整的交互式应用程序——通常在一个 prompt 中即可完成。

Anthropic 在发布 Claude Artifacts 时,将这个想法推向了高潮,这是一个突破性的新功能,最初在 他们令人难以置信的 Claude 3.5 Sonnet 的公告 中途被描述,因此在噪音中略有迷失。

借助 Artifacts,Claude 可以为你编写一个按需交互式应用程序,然后在 Claude 界面内直接 让你使用它 。

从那时起,许多其他团队构建了类似的系统。GitHub 在 10 月份宣布了他们的版本——GitHub Spark。Mistral Chat 在 11 月 将其添加为一项名为 Canvas 的功能。

Val Town 的 Steve Krouse 针对 Cerebras 构建了一个版本,展示了每秒 2,000 个 token 的 LLM 如何在不到一秒钟的时间内迭代应用程序,并使更改可见。

然后在 12 月,Chatbot Arena 团队为这个功能引入了 一个全新的排行榜,由用户使用两个不同的模型两次构建相同的交互式应用程序并对答案进行投票来驱动。很难提出更有说服力的论据来证明此功能现在是一种商品,可以有效地针对所有领先模型实施。

这种 prompt 驱动的自定义界面功能非常强大且易于构建(一旦你弄清楚了浏览器沙箱的复杂细节),我预计它将在 2025 年作为一项功能出现在各种各样的产品中。

通用访问最佳模型的时代只持续了短短几个月

在今年短短的几个月里,所有三个可用的最佳模型——GPT-4o、Claude 3.5 Sonnet 和 Gemini 1.5 Pro——都对世界上大多数人免费开放。

OpenAI 在 5 月 将 GPT-4o 对所有用户免费开放,Claude 3.5 Sonnet 从 6 月发布时 就免费提供。这是一个重要的变化,因为在前一年,免费用户主要被限制在 GPT-3.5 级别的模型,这意味着新用户对有能力的 LLM 实际上可以做什么产生了 非常 不准确的心智模型。

随着 OpenAI 推出 ChatGPT Pro,这个时代似乎已经结束,可能永远结束了。这项每月 200 美元的订阅服务是访问他们最强大的模型 o1 Pro 的唯一途径。

由于 o1 系列(以及未来无疑会受到启发的模型)背后的诀窍是花费更多的计算时间来获得更好的结果,因此我不认为免费访问可用最佳模型的日子可能会重返。

“代理(Agents)” 仍然没有真正实现

我发现“代理(agents)”这个术语非常令人沮丧。它缺乏一个单一、清晰且被广泛理解的含义……但是使用这个术语的人似乎从不承认这一点。

如果你告诉我你正在构建“代理(agents)”,那你几乎没有向我传达任何信息。如果不读懂你的心思,我就无法判断你在谈论的是数十种可能的定义中的哪一种。

我看到的两个主要类别是,有些人认为 AI 代理(agents)显然是代表你行事的东西——旅行社模型——有些人则从 LLM 的角度思考,LLM 已被授予对其可以循环运行的工具的访问权限,作为解决问题的一部分。“自主性(autonomy)”这个术语也经常被混入其中,同样没有包含明确的定义。

无论该术语可能意味着什么,代理(agents)仍然具有永远“即将推出”的感觉。

抛开术语不谈,我对它们的实用性仍然持怀疑态度,再次基于 轻信 的挑战。LLM 相信你告诉它们的任何事情。任何试图代表你做出有意义的决定的系统都会遇到同样的障碍:如果旅行社、数字助理甚至研究工具无法区分真假,那它们有多好?

我开始将最流行的“代理(agents)”概念视为依赖于 AGI 本身。一个能够抵御轻信的模型确实是一个非常高的要求。

评估(Evals)非常重要

Anthropic 的 Amanda Askell(负责 Claude 的性格背后的许多工作]):

好的系统 prompt 背后的枯燥但至关重要的秘密是测试驱动开发。你不会写下一个系统 prompt 并找到测试它的方法。你写下测试并找到一个通过这些测试的系统 prompt。

在 2024 年的过程中,人们越来越清楚地认识到,为 LLM 驱动的系统编写好的自动化评估(evals)是 构建在这些模型之上的有用应用程序最需要的技能。如果你有一个强大的评估(eval)套件,你就可以更快地采用新模型,更好地迭代,并构建比竞争对手更可靠和更有用的产品功能。

Vercel 的 Malte Ubl:

当 @v0 首次推出时,我们非常担心通过各种预处理和后处理复杂性来保护 prompt。

我们完全转向放手一搏。一个没有评估(evals)、模型,尤其是 UX 的 prompt 就像得到一台没有手册的损坏的 ASML 机器

Apple Intelligence 很糟糕,Apple 的 MLX 库非常出色

作为 Mac 用户,今年我对我的平台选择感觉好多了。

去年,感觉我缺少一台带有 NVIDIA GPU 的 Linux/Windows 机器在尝试新模型方面是一个巨大的劣势。

从理论上讲,64GB 的 Mac 应该是一台运行模型的出色机器,因为它 CPU 和 GPU 可以共享相同的内存。但在实践中,许多模型以模型权重和库的形式发布,这些模型奖励 NVIDIA 的 CUDA 而不是其他平台。

llama.cpp 生态系统在这里提供了很大的帮助,但真正的突破是 Apple 的 MLX 库,“Apple Silicon 的数组框架”。它非常棒。

Apple 的 mlx-lm Python 库支持在我的 Mac 上运行各种 MLX 兼容模型,并具有出色的性能。mlx-community 在 Hugging Face 上提供了 1,000 多个已转换为必要格式的模型。

Prince Canuma 出色的、快速发展的 mlx-vlm 项目也将视觉 LLM 带到了 Apple Silicon。。

虽然 MLX 是一个游戏规则改变者,但 Apple 自己的“Apple Intelligence”功能在很大程度上令人失望。我乐观地认为 Apple 专注于 LLM 应用的子集,这些应用可以保护用户隐私并最大限度地减少用户被令人困惑的功能误导的可能性。

现在这些功能正在推出,它们非常弱。作为一名 LLM 高级用户,我知道这些模型的功能,而 Apple 的 LLM 功能提供的只是前沿 LLM 可以做到的事情的苍白模仿。我发现这些工具根本没有用。Genmoji 有点有趣。

推理扩展“推理(reasoning)”模型的兴起

2024 年最后一个季度最有趣的发展是推出了一种新的 LLM 形态,OpenAI 的 o1 模型是其中的典范——最初作为 o1-preview 和 o1-mini 在 9 月 12 日发布。

思考这些模型的一种方法是扩展思维链(chain-of-thought)prompt 技巧,该技巧最初在 2022 年 5 月的论文 大型语言模型是零样本推理器 中进行了探索。

这是一个技巧,如果你让模型大声说出它正在解决的问题,你通常会得到模型本来无法实现的结果。

o1 采用此过程,并进一步将其融入到模型本身中。细节有些模糊:o1 模型花费“推理 token”来思考用户不可见的问题(尽管 ChatGPT UI 显示了它们的摘要),然后输出最终结果。

这里最大的创新是,它开辟了一种扩展模型的新方法:模型现在可以通过在推理上花费更多计算资源来应对更难的问题,而不是仅仅通过在训练时增加计算资源来提高模型性能。

o1 的续集 o3(出于欧洲商标原因,他们跳过了“o2”)在 12 月 20 日宣布,在 ARC-AGI 基准 上取得了令人印象深刻的结果,尽管这可能涉及超过 1,000,000 美元的计算时间成本!

o3 预计将于 1 月份发货。我怀疑有多少人的现实世界问题会从这种计算支出水平中受益——我肯定没有!——但这似乎是 LLM 架构在应对更困难问题方面的真正下一步。

OpenAI 并不是这里唯一的参与者。Google 发布了他们在该类别中的首个产品 gemini-2.0-flash-thinking-exp,于 12 月 19 日发布。

阿里巴巴的 Qwen 团队 于 11 月 28 日发布了他们的 QwQ 模型 ——在 Apache 2.0 许可下,而且我可以在我自己的机器上运行它。他们随后在 12 月 24 日推出了一个名为 QvQ 的视觉推理模型,。

DeepSeek 在 11 月 20 日 通过他们的聊天界面提供了 DeepSeek-R1-Lite-Preview 模型供试用。

要了解更多关于推理扩展的信息,我推荐 Arvind Narayanan 和 Sayash Kapoor 的 AI 进步正在放缓吗?。

Anthropic 或 Meta 尚未发布任何消息,但如果他们没有正在开发自己的推理扩展模型,我会感到非常惊讶。Meta 在 12 月份发表了一篇相关论文 训练大型语言模型在连续潜在空间中进行推理。

目前最好的 LLM 是在中国训练的,成本不到 600 万美元吗?

不完全是,但几乎是!但这确实是一个引人注目的标题。

今年年底的大新闻是 DeepSeek v3 的发布——在圣诞节当天在 Hugging Face 上发布,甚至没有 README 文件,然后在 第二天 发布了文档和论文。

DeepSeek v3 是一个庞大的 685B 参数模型——目前可用的最大开源许可模型之一,明显大于 Meta 的 Llama 系列中最大的模型 Llama 3.1 405B。

基准测试将其与 Claude 3.5 Sonnet 相提并论。氛围基准测试(又名 Chatbot Arena)目前将其排在第 7 位,仅次于 Gemini 2.0 和 OpenAI 4o/o1 模型。这是迄今为止排名最高的开源许可模型。

DeepSeek v3 真正令人印象深刻的是训练成本。该模型在 2,788,000 个 H800 GPU 小时内训练完成,估计成本为 5,576,000 美元。Llama 3.1 405B 训练了 30,840,000 个 GPU 小时——是 DeepSeek v3 使用时间的 11 倍,但模型的基准测试结果略逊一筹。

那些 美国对中国 GPU 的出口管制规定 似乎激发了一些 非常 有效的训练优化!

环境影响有所改善

模型效率提高(托管模型和我可以在本地运行的模型)的一个可喜结果是,在过去几年中,运行 prompt 的能源使用量和环境影响已大大降低。

与 GPT-3 时代相比,OpenAI 本身对一个 prompt 的收费降低了 100 倍。我有可靠的消息来源称,Google Gemini 和 Amazon Nova(两个最便宜的模型提供商)都没有亏本运行。

我认为这意味着,作为个人用户,我们不必为我们绝大多数 prompt 消耗的能源感到任何内疚。与开车下街甚至在 YouTube 上观看视频相比,其影响可能是微不足道的。

训练也是如此。DeepSeek v3 的训练成本低于 600 万美元,这是一个极好的迹象,表明训练成本可以而且应该继续下降。

对于效率较低的模型,我发现将它们的能源使用量与商业航班进行比较很有用。最大的 Llama 3 模型的成本与从纽约到伦敦的个位数满载客运航班的成本大致相同。这当然不是什么都没有,但是一旦训练完成,该模型就可以供数百万人使用,而无需额外的训练成本。

环境影响变得更糟

这里更大的问题是,为未来这些模型设想的必要基础设施的巨大竞争性建设。

像 Google、Meta、Microsoft 和 Amazon 这样的公司都在花费数十亿美元推出新的数据中心,这对 电网 和环境产生了非常重大的影响。甚至有人谈论 启动新的核电站,但这些核电站可能需要数十年才能建成。

这种基础设施是必要的吗?DeepSeek v3 的 600 万美元训练成本和 LLM 价格的持续暴跌可能暗示并非如此。但是,你会想成为那个主张不建设这种基础设施,但几年后被证明是错误的科技巨头高管吗?

这里一个有趣的比较点可能是 1800 年代铁路在世界各地的推广方式。建造这些铁路需要巨额投资,并对环境产生了巨大的影响,而且许多建造的线路最终被证明是不必要的——有时来自不同公司的多条线路服务于完全相同的路线!

由此产生的泡沫导致了几次金融危机,请参阅维基百科了解 1873 年恐慌、1893 年恐慌、1901 年恐慌 和英国的 铁路狂热。它们给我们留下了许多有用的基础设施,以及大量的破产和环境破坏。

草率之年(The year of slop)

2024 年是 “草率(slop)” 一词成为术语的一年。

实时观看“草率(slop)”成为一个术语。就像“垃圾邮件(spam)”成为不需要的电子邮件的术语一样,“草率(slop)”正在进入字典,成为不需要的 AI 生成内容的术语

我将该定义稍微扩展到:

草率(Slop) 描述的是 未经请求 且 未经审查 的 AI 生成内容。

我最终在 卫报 和 纽约时报 上都被引用谈论草率(slop)。这是我在《纽约时报》上说的:

社会需要简洁的方式来谈论现代人工智能——包括积极方面和消极方面。“忽略那封电子邮件,它是垃圾邮件(spam)”,以及“忽略那篇文章,它是草率(slop)”,都是有用的教训。

我喜欢“草率(slop)”这个词,因为它简洁地概括了我们 不应该 使用生成式 AI 的方式之一!

草率(Slop)甚至入围了 2024 年牛津年度词汇 的候选名单,但它输给了 大脑腐烂(brain rot)。

合成训练数据效果很好

一个令人惊讶地似乎已经深入人心的想法是“模型崩溃”。这最初在 2023 年 5 月的论文 递归的诅咒:在生成的数据上训练使模型遗忘 中描述,并在 2024 年 7 月在《自然》杂志上以更引人注目的标题 AI 模型在递归生成的数据上训练时会崩溃 中重复。

这个想法很诱人:随着互联网充斥着 AI 生成的草率内容,模型本身将退化,以一种导致它们不可避免地灭亡的方式以它们自己的输出为食!

这显然没有发生。相反,我们看到 AI 实验室越来越多地在 合成内容 上进行训练——故意创建人工数据以帮助引导他们的模型朝着正确的方向发展。

我见过的对此最好的描述之一来自 Phi-4 技术报告,其中包括:

合成数据作为预训练的重要组成部分正变得越来越普遍,Phi 系列模型一直强调合成数据的重要性。合成数据不是作为有机数据的廉价替代品,而是比有机数据具有几个直接优势。

结构化和渐进式学习。在有机数据集中,token 之间的关系通常是复杂且间接的。可能需要许多推理步骤才能将当前 token 连接到下一个 token,这使得模型难以从下一个 token 预测中有效地学习。相比之下,语言模型生成的每个 token 都根据定义由前面的 token 预测,这使得模型更容易遵循由此产生的推理模式。

另一种常见的技术是使用更大的模型来帮助为其更小、更便宜的替代品创建训练数据——越来越多的实验室使用这种技巧。DeepSeek v3 使用了 DeepSeek-R1 创建的“推理”数据。Meta 的 Llama 3.3 70B 微调使用了 超过 2500 万个合成生成的示例。

精心设计输入 LLM 的训练数据似乎是创建这些模型的 整个游戏 。仅仅抓取网络的完整抓取并随意将其倾倒到训练运行中的日子早已一去不复返了。

LLM 不知何故变得更难使用了

我一直在强调的一个论点是,LLM 是高级用户工具——它们是伪装成厨房刀具的链锯。它们看起来易于使用——向聊天机器人输入消息有多难?——但实际上,你需要大量的理解和经验才能充分利用它们并避免它们的许多陷阱。

如果说有什么不同的话,那就是这个问题在 2024 年变得更糟了。

我们已经构建了你可以用人类语言交谈的计算机系统,它们会回答你的问题并且 通常 会回答正确!……但这取决于问题,以及你如何提问,以及它是否准确地反映在未公开且秘密的训练集中。

可用系统的数量呈爆炸式增长。不同的系统具有不同的工具,它们可以将这些工具应用于你的问题——例如 Python 和 JavaScript 以及 Web 搜索和图像生成,甚至可能是数据库查找……因此你最好了解这些工具是什么,它们可以做什么,以及如何判断 LLM 是否使用了它们。

你知道 ChatGPT 现在有 两种完全不同的方式 来运行 Python 吗?

想要构建一个与外部 API 对话的 Claude Artifacts?你最好首先了解 CSP 和 CORS HTTP 标头。

模型可能变得更强大了,但大多数限制仍然相同。OpenAI 的 o1 可能最终能够(大部分)数清草莓中的 R,但它的能力仍然受到其作为 LLM 的性质以及它运行的环境对其施加的约束的限制。o1 无法运行 Web 搜索或使用 Code Interpreter,但 GPT-4o 可以——都在同一个 ChatGPT UI 中。(如果你要求 o1 执行这些操作,它会假装执行,这是 2023 年初 URL 幻觉错误的倒退)。

我们正在对此做些什么?不多。大多数用户都被扔进了深水区。默认的 LLM 聊天 UI 就像对待全新的计算机用户一样,将他们扔进 Linux 终端并期望他们自己弄清楚一切。

与此同时,最终用户越来越普遍地形成关于这些东西如何工作以及它们能够做什么的非常不准确的心智模型。我见过太多人试图用 ChatGPT 的屏幕截图来赢得争论的例子——这本身就是一个荒谬的主张,因为这些模型天生就不可靠,再加上事实上,如果你 prompt 它们正确,你可以让它们说任何话。

这也存在一个反面:许多更了解情况的人已经完全放弃了 LLM,因为他们看不到任何人如何从一个有如此多缺陷的工具中受益。充分利用 LLM 的关键技能是学习使用既天生不可靠又极其强大的技术。这是一项非常不明显的技能!

在这里,有 非常大的空间 用于提供有用的教育内容,但是我们需要做得比将所有内容外包给在 Twitter 上发布夸夸其谈的帖子的 AI 骗子要好得多。

知识的分布极其不均

现在大多数人都听说过 ChatGPT。有多少人听说过 Claude?

积极关注这些内容的人与 99% 不关注这些内容的人之间的知识差距是 巨大的 。

变化的步伐也无济于事。就在过去一个月里,我们看到了实时界面的普遍可用性,你可以在这些界面中 将手机的摄像头对准 某物并 用你的声音谈论它 ……并且可以选择让它 假装成圣诞老人。大多数自称是书呆子的人甚至还没有尝试过。

考虑到这项技术对社会正在产生(和潜在的)影响,我不认为这种差距的规模是健康的。我希望看到更多努力来改善这种情况。

LLM 需要更好的批评

很多人 非常讨厌 这些东西。在我闲逛的一些空间(Mastodon、Bluesky、Lobste.rs,甚至偶尔在 Hacker News 上)中,即使只是暗示“LLM 有用”也足以引发一场巨大的争吵。

我理解。有很多理由不喜欢这项技术——环境影响、训练数据的(缺乏)伦理、缺乏可靠性、负面应用、对人们工作的潜在影响。

LLM 绝对值得批评。我们需要讨论这些问题,找到减轻这些问题的方法,并帮助人们学习如何负责任地使用这些工具,使积极应用超过消极应用。

我 喜欢 那些对这些东西持怀疑态度的人。炒作已经震耳欲聋两年多了,并且存在大量的伪劣产品和错误信息。许多 非常糟糕的 决定都是基于这种炒作做出的。保持批判性是一种美德。

如果我们希望具有决策权的人对如何应用这些工具做出 好的决定 ,我们首先需要承认存在好的应用,然后帮助解释如何在实践中应用这些工具,同时避免许多违反直觉的陷阱。

(如果你仍然认为根本没有任何好的应用,我不确定你为什么能看到文章的这一点!)

我认为告诉人们整个领域都是环境灾难性的剽窃机器,它们不断地编造东西,这对这些人是不公平的,无论这代表了多少真相。这里确实有真正的价值可以获得,但是获得这种价值是不直观的,并且需要指导。

我们这些了解这些东西的人有责任帮助其他人弄清楚。